En mathématiques, une relation transitive est une relation binaire pour laquelle une suite d’objets reliés consécutivement aboutit à une relation entre le premier et le dernier.

La relation > est transitive, en effet si a > b et b >c => a > c

En revanche, la relation ≠ n’est pas transitive, en effet si a ≠ b et b ≠ c, rien ne permet d’affirmer ni que a ≠ c, ni que a = c.

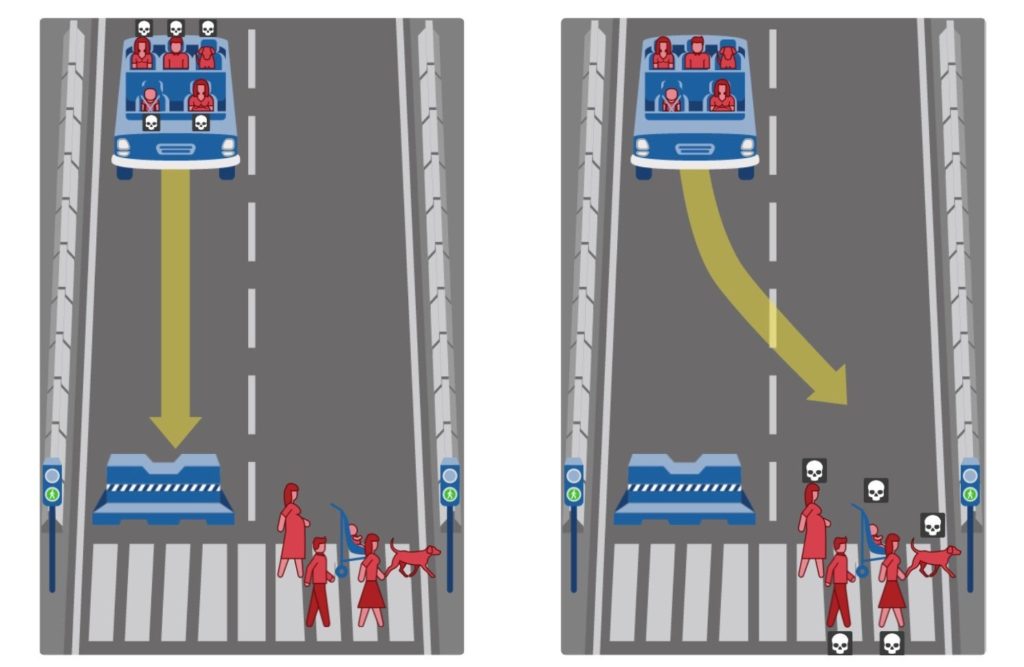

Le paradoxe de Condorcet dit qu’il est possible – lors d’un vote où l’on demande aux votants de classer trois propositions (A, B et C) par ordre de préférence – qu’une majorité de votants préfère A à B, qu’une autre préfère B à C et qu’une autre préfère C à A (Le vote, à travers la relation de préférence, est non transitif).

Les décisions prises à une majorité populaire par ce mode de scrutin ne sont donc pas, dans ce cas, cohérentes avec celles que prendrait un individu supposé rationnel, car pour ce dernier, la relation de préférence est transitive.

La non-transitivité de la relation de préférence entraîne le paradoxe de Condorcet, mais ne devrait pas être considérée en elle-même comme paradoxale. Elle n’est en effet pas plus paradoxale que le jeu pierre-feuille-ciseaux où

- La feuille l’emporte sur la pierre (F>P)

- La pierre l’emporte sur les ciseaux (P>C)

- Les ciseaux l’emportent sur la feuille (C>F) (Si c’était transitif, on aura F>C)

Quand l’information traitée est plus complète et renseigne sur l’intensité des préférences (et plus simplement les préférences), des procédures permettent de classer rationnellement des candidats sans paradoxe. De telles procédures sont par exemple utilisées pour évaluer des réponses à appel d’offres.